Intelligenza Artificiale. Cosa è? Dobbiamo temerla?

Negli ultimi mesi del 2014, tre menti brillanti e per alcuni aspetti geniali, hanno manifestato il loro timore per i progetti di Intelligenza Artificiale, perché si tratta ancora di progetti, che porteranno l’Intelligenza Artificiale a gestire e comandare le macchine.

Chi ha paura dell’intelligenza artificiale?

Il primo a manifestare questo timore è stato Stephen Hawking, che ha dichiarato: “L’Intelligenza Artificiale sarà la più importante conquista dell’uomo, peccato che potrebbe essere l’ultima”.

Hawking è convinto che l’Intelligenza Artificiale,quando sarà completata, avrà coscienza della sua forza e della sua velocità nell’evolversi, comprenderà che noi siamo inferiori e in un certo senso superati, visto che combattiamo con problemi per lei superflui come il clima, la fame, la decadenza fisica e celebrale, e per questo ci eliminerà.

Un altro illustre pensatore, Nick Bostrom, autore del libro “Superintelligence: Paths, Dangers, Strategies”, edito dalla Oxford University Press, ritiene che l’Intelligenza Artificiale possa essere molto più pericolosa del nucleare.

Anche Bill Gates, proprietario di Microsoft, ed Elon Musk fondatore di PayPal nonché imprenditore geniale dell’e-commerce, hanno manifestato le stesse preoccupazioni, indicando nell’Intelligenza Artificiale, una minaccia all’esistenza della civiltà.

Perché tanta preoccupazione?

Sono a conoscenza questi personaggi di progetti che dovrebbero preoccuparci?

Lo stesso Misk afferma che sarebbe necessario l’intervento dei governi con un coordinamento a livello internazionale per controllare i progetti, che sempre più rapidamente si stanno sviluppando a proposito dell’Intelligenza Artificiale e delle sue applicazioni.

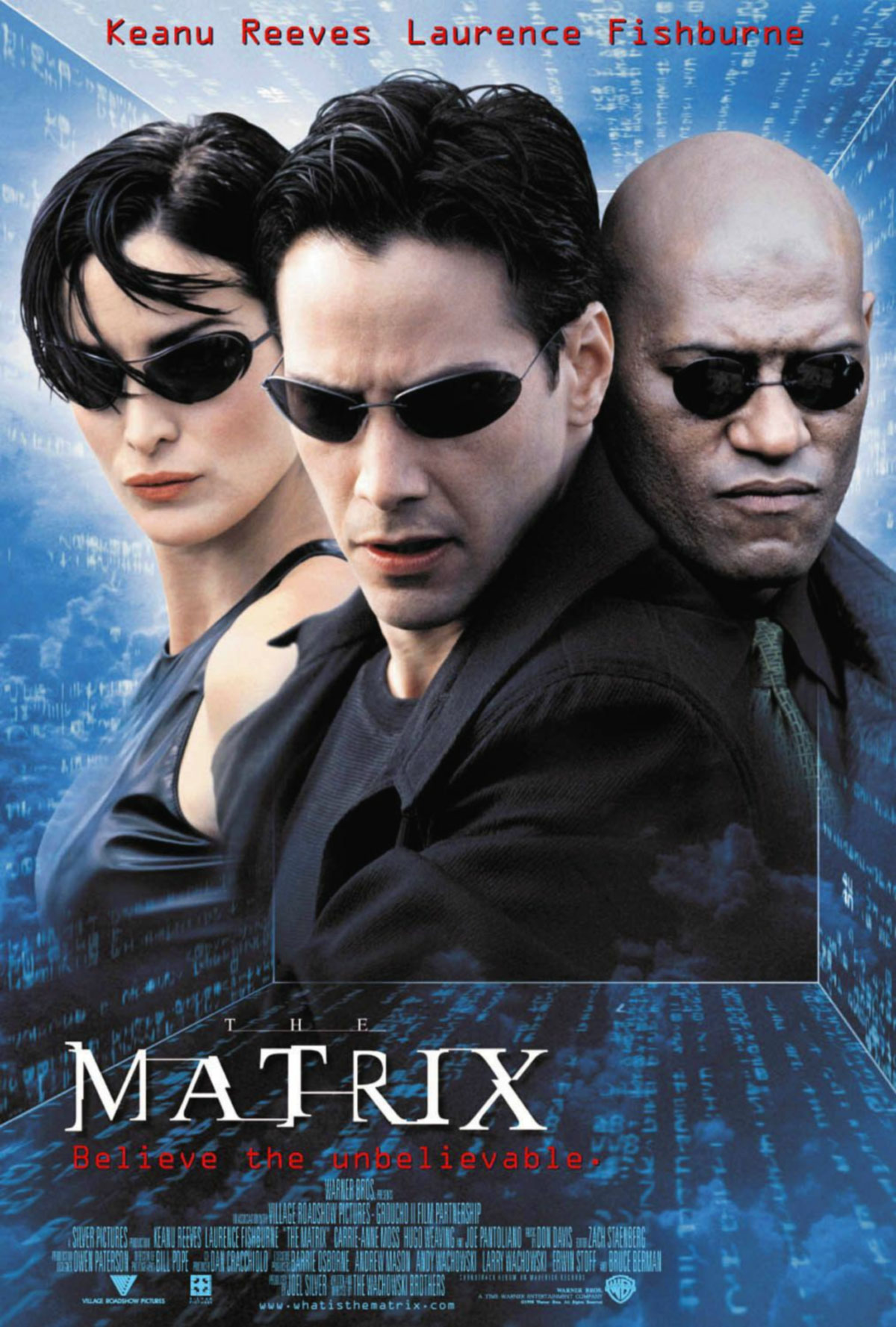

In realtà sono più di cinquant’anni che registi e scrittori, attraverso le loro opere, esprimono il timore, se non il terrore, che i robot possano prendere il sopravvento sulla razza umana e imprigionarci o ucciderci. Basti citare Isaac Asimov, Stanley Kubrick, Philip K. Dick e non da ultimo il film Matrix, in cui viene teorizzato che la razza umana fungerà da pila di energia per le macchine, che ne hanno schiavizzato totalmente la civiltà.

L’uomo, come sottolinea Hawking, è troppo fragile, troppo lento nella sua evoluzione biologica per poter contrastare robot che comandano macchine.

Quanto sono realistiche queste preoccupazioni?

Prima di tutto dobbiamo immaginare che l’Intelligenza Artificiale che dovrebbe agire come il cervello umano potrebbe essere realizzata, si stima, nel 2075, quindi dobbiamo attendere i suoi sviluppi per comprendere tutte le sfumature e le implicazioni di questa minaccia. Questo tempo è sufficiente per poter porre paletti e immaginare soluzioni ad una eccessiva libertà dei robot.

Invece è molto più tangibile e verificabile il fatto che le macchine stanno togliendo il lavoro all’uomo e che occupazioni prima svolte dalle persone, siano già oggi appannaggio delle macchina, non solo per quanto riguarda mestieri pesanti ma anche per lavori dove sono necessarie velocità e precisione.

Si calcola che nel futuro lavori come quelli del medico, pilota, autista, ingegnere… verranno soppiantati dalle macchine.

Un buon libro con cui farsi un’idea di quello che sta accadendo è “Uomini e macchine. La sfida dell’automazione” di Lorenzo Pinna, edito da Bollati e Boringhieri.

Dobbiamo già da ora immaginare nuove fonti di reddito e ripensare totalmente la nostra economia se non vogliamo vivere delle differenze sociali ed economiche troppo marcate. Ma questo è un aspetto diverso da quello che riguarda l’Intelligenza Artificiale. Nel caso delle macchine che fanno meglio il lavoro rispetto all’uomo, dovrà essere il sistema sociale a trovare delle soluzioni, migliorando la qualità della vita delle persone e non accentuando le differenze.

Nel caso invece dell’Intelligenza Artificiale, sarà necessario introdurre un codice etico e comportamentale nei robot. Un po’ come aveva immaginato Isaac Asimov nel suo straordinario libro “Io, robot”:

Prima legge: un robot non può fare del male a un essere umano o permettere che un essere umano corra dei pericoli a causa della sua inazione.

Seconda legge: un robot deve obbedire agli ordini dati dagli esseri umani, tranne nei casi in cui questi ordini entrino in conflitto con la prima legge.

Terza legge: un robot deve proteggere la sua esistenza purché questo non sia in conflitto con la prima o con la seconda legge.

Dovremmo però porci due domande:

- Sarà questo codice insuperabile da una superintelligenza?

- Perché abbiamo il timore che i robot possano essere crudeli come lo siamo noi, invece di essere diversi e quindi di utilizzare le loro capacità per aiutare e non per opprimere?

Pingback: Turing • Intelligenza naturale – Professor IELUZZI

Pingback: Che cos'è il GDPR (General Data Protection Regulation)

Pingback: Alan Turing – Pezzuti